L’interface entre le siège et l’ordinateur est une IA à la place d’un humain... Manipuler un ordinateur et ses applications à l’aide de la souris et du clavier, c'est ce dont est capable la nouvelle version de Claude Sonnet 3.5 d’Anthropic. Une évolution pour le meilleur et peut-être pour le pire.

au sommaire

Conduire nos autos, répondre au courrier, générer des images et des vidéos à notre place... Bientôt, les IAIA vont pouvoir nous remplacer dans de larges domaines de nos vies, pour le meilleur et peut-être pour le pire. Pour le meilleur, mieux vaut compter sur le côté éthique et vertueux de la firme Anthropic qui développe le chatbot Claude. Ses fondateurs sont d'anciens membres d'OpenAI partis en raison des orientations prises par l'entreprise. Ils misent sur l'intérêt public de l'IA plutôt que sur le profit immédiat, avec les conséquences catastrophiques que cela pourrait entraîner. Et, paradoxalement, pour le pire, Anthropic vient de publier une version améliorée de Claude 3.5 Sonnet. Sa particularité est qu'elle est capable de comprendre et d'interagir avec n'importe quelle applicationapplication de bureau. Autrement dit, l'IA peut se substituer à l'interface « siège-écran-clavier », c'est-à-dire Homo sapiensHomo sapiens.

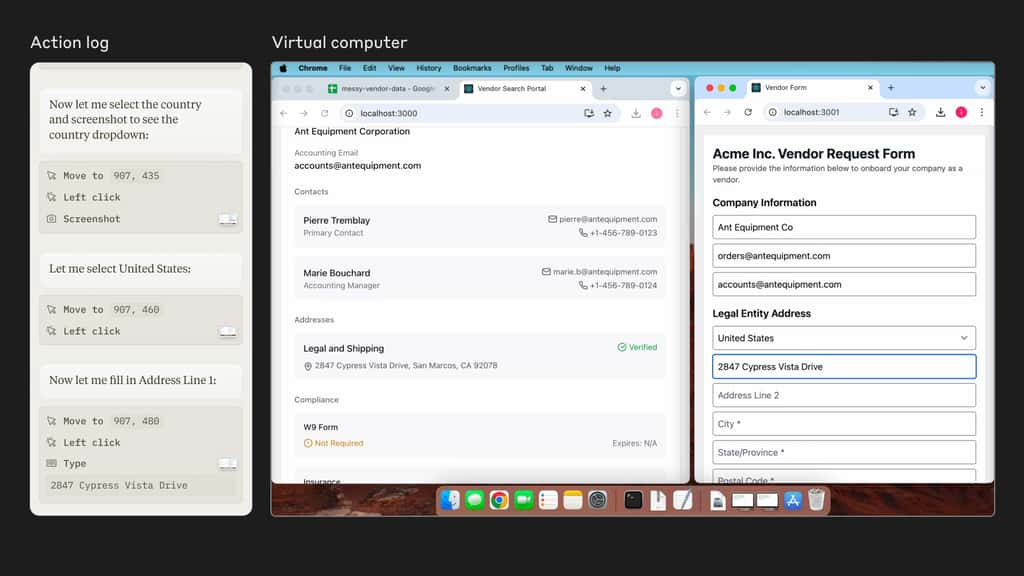

Ainsi, grâce à une API baptisée « Computer Use », le nouveau modèle disponible en version bêta ouverte sait imiter les frappes au clavier, les clics sur les boutons et les gestes de la souris. Pour parvenir à ce résultat, Anthropic a formé son modèle à voir et déchiffrer ce qui se passe à l'écran via des captures. Ensuite, il utilise les outils des logiciels à l'écran pour réaliser des tâches. Pour déplacer le pointeur de souris au bon endroit et cliquer, Claude compte le nombre de pixelspixels verticaux et horizontaux. Au final, cela donne l'illusion d'une personne réelle assise devant son ordinateurordinateur.

On peut très rapidement imaginer l'intérêt d'un tel système en mode « télétravail ». Pratique pour faire croire que l'on est devant l'ordinateur pendant la sieste. On peut également imaginer une forme de mise en abîme. Avec cette capacité, devant l'ordinateur, Claude est potentiellement capable d'utiliser ChatGPTChatGPT, Gemini et peut-être même lui-même...

Plus sérieusement, cette interface autonome a de quoi inquiéter si elle est détournée. Implantée par des hackers sur un ordinateur, elle pourrait permettre d'exploiter directement les vulnérabilités des applications et ce n'est qu'un exemple. Sans nier que le nouveau Claude Sonnet 3.5 pourrait être utilisé à de mauvaises fins, Anthropic souligne les avantages que l'on pourra tirer de son utilisation.

Une IA au clavier et à la souris

Pour eux, c'est l'usage qui déterminera également ce qui peut être fait à partir de cet outil. Son utilisation permettra d'augmenter le niveau de sécurisation en conséquence. Et dans tous les cas, les humains gardent le contrôle en fournissant des invites spécifiques. Ce sont elles qui dirigent les actions de Claude. Cela peut passer par des exemples comme « utilise les données de mon ordinateur et en ligne pour remplir ce formulaire », selon une interview d'un responsable d'Anthropic réalisée par le média TechCrunch. Claude a, par exemple, été testé pour sa capacité à réserver un vol ou modifier la réservation de celui-ci. Il n'y parvenait que dans la moitié des cas. Ceci dit, il n'est pas rare qu'un humain rencontre aussi des difficultés avec une interface de réservation en ligne. Mais ce n'est que le début...

Si c'est une première pour Claude, l'exécution de commandes sur un ordinateur tel un utilisateur, pour surfer sur InternetInternet par exemple, n'est pas une nouveauté dans l'universunivers des IA. Certains processus spécifiques sur un ordinateur peuvent déjà être exploités par une interface reposant sur GPT-4o, par exemple. Mais le modèle d’Anthropic serait plus puissant et robuste. Il peut également s'autocorriger en essayant de réaliser autrement une tâche lorsqu'il rencontre des obstacles. Il sait également parvenir à des objectifs nécessitant des centaines d'étapes.

Cependant, pour le moment, Anthropic admet que la nouvelle mouture de Claude a quelques difficultés avec des actions basiques comme le défilement et le zoom et peut aussi manquer certaines actions et notifications en raison de son système d'analyse des captures d'écrancaptures d'écran. Bref, si le principe est là, son exploitation de façon fluide est loin d'être gagnée et encore moins lorsqu'il s'agit de mener des actions abusives. Au niveau de la sécurité, pour le moment, des bridages empêchent Claude de publier sur les réseaux sociauxréseaux sociaux, de créer des comptes en ligne et d'interagir avec des sites Web gouvernementaux. Malgré leur volonté de minimiser les risques, ces bridages montrent une certaine fébrilité de la part d'Anthropic quant à l'utilisation que l'on pourrait faire de cette interface.