au sommaire

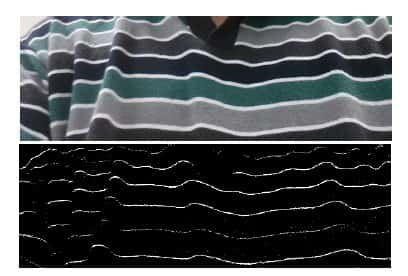

À partir d’une photo prise avec la caméra frontale du smartphone et cadrée sur le buste de l’utilisateur, InSight va extraire une empreinte spécifique du vêtement en prenant en compte les couleurs, leur disposition et les motifs. Pour que le système de reconnaissance fonctionne, il faut que la personne porte les mêmes vêtements qu’au moment où elle a créé l’empreinte numérique. © University of South Carolina, Duke University

Tout commence par un scénario classique. Une personne a rendez-vous avec un ami pour assister à un concert. Problème, l'ami en question se trouve quelque part dans la foule qui piétine pour entrer dans la salle. Plutôt que dégainer son mobile pour appeler, la personne chausse tranquillement sa paire de lunettes à réalité augmentée et commence à balayer l'assistance du regard. Soudain, sur l'écran projeté devant ses yeuxyeux apparaît une flèche qui lui désigne son ami, de dosdos au milieu d'un groupe.

Cette applicationapplication existe : elle se nomme InSight. Elle évoque l'une des réalisations du projet UI-Art de l'université Aalto, en Finlande, consistant en une paire de lunettes à réalité augmentée capable de reconnaissance faciale. InsightInsight va plus loin en analysant ses vêtements. C'est une équipe réunissant des professeurs américains de la Duke University (Caroline du Nord) et de l'University of South Carolina qui l'a mise au point. L'objectif était de la faire fonctionner sur les lunettes à réalité augmentée Glass de GoogleGoogle, qui a d'ailleurs financé en partie le développement de ce projet.

L'application analyse la couleurcouleur des vêtements, les motifs ainsi que la manière de se mouvoir. Pris ensemble, ces éléments forment une sorte d'« empreinte digitale » spécifique à chaque individu. « Notre technique est complémentaire de la reconnaissance faciale et exploite l'idée que les couleurs des vêtements, les motifs et même la façon de bouger forment une empreinte digitaleempreinte digitale », expliquent les inventeurs d'InSight.

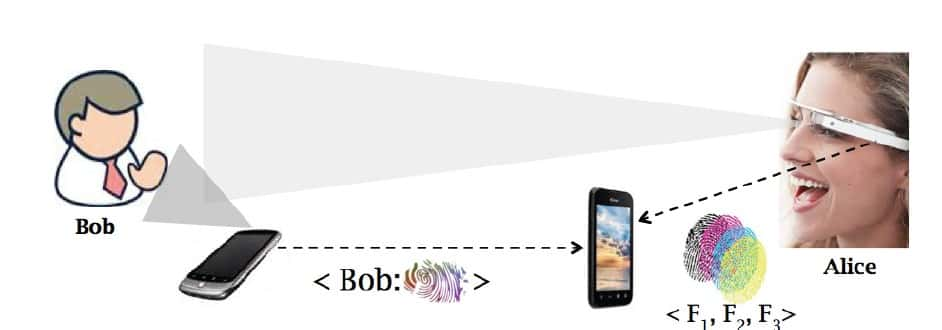

Schéma illustrant le fonctionnement de l’application InSight. Bob créé une empreinte « spatiochromatique » à partir d’une série de photos prises par son smartphone. Cette empreinte est alors diffusée aux terminaux mobiles présents dans les environs via une liaison Bluetooth. Lorsqu’Alice regarde dans la foule avec ses lunettes à réalité augmentée, InSight relève les empreintes spatiochromatiques de chaque individu (F1, F2, F3, etc.) et les compare avec celle de Bob. Si une correspondance est établie, une flèche virtuelle signale à Alice la position de Bob dans la foule. © University of South Carolina, Duke University

Google Glass et empreintes « spatiochromatiques »

Pour mieux saisir le fonctionnement de l'application, il faut imaginer un scénario impliquant deux personnes. À chaque fois qu'un utilisateur A se sert de son smartphone, InSight prend automatiquement une série de photos grâce à la caméra frontale en délimitant une zone carrée qui se situe au niveau du torse. Les images sont traitées pour en extraire des identifiants visuels comme les couleurs, leur disposition, les motifs. Cette empreinte dite « spatiochromatique » est ensuite diffusée aux smartphones alentour via une connexion Bluetooth, accompagnée du prénom de la personne ou du message court qu'elle souhaite diffuser. Les créateurs d'InSight précisent que les informations peuvent aussi être envoyées sur des serveurs distants auxquels les mobiles se connectent pour consulter la base d'empreintes spatiochromatiques.

Si une personne B équipée d'une paire de lunettes à réalité augmentée connectée à un smartphone promène son regard dans la foule et souhaite trouver A, il lui suffit de presser un bouton placé sur la monture. La caméra intégrée enregistre alors une séquence vidéo de trois secondes qui est transmise au smartphone. Celui-ci va en extraire une image pour l'analyser afin de distinguer chaque individu et collecter son empreinte spatiochromatique. Si l'une des empreintes correspond à celle de l'utilisateur A avec un niveau de certitude suffisant, le smartphone va l'identifier. Il signale alors la position de la personne dans la foule sur l'écran des lunettes, en faisant apparaître une flèche au-dessus de sa tête. Dans le cas où le rapprochement n'offre pas un pourcentage de certitude assez élevé, InSight complète l'identification en prenant en compte les mouvementsmouvements spécifiques d'une personne qui ont été collectés par l'accéléromètre et la boussole de son smartphone.

Reconnaissance visuelle à 93 % de réussite

Les utilisateurs pourraient se servir de l'application non seulement pour s'identifier, mais aussi pour diffuser un message court plus spécifique selon les circonstances. Exemple : dans un aéroport, un utilisateur qui cherche à partager un taxi pourrait le signaler grâce à InSight, et les personnes intéressées portant leurs lunettes spéciales en seraient informées en voyant le message flotter au-dessus de l'utilisateur. Au cours d'une réunion professionnelle, une personne munie des lunettes pourrait voir les noms des participants s'afficher au-dessus de leur tête à la place des badges que l'on porteporte habituellement sur la poitrine. On peut également penser à des échanges entre les membres d'un réseau social, qui pourraient signaler leur appartenance grâce à InSight.

Lors des tests effectués par l'équipe d'universitaires avec 15 volontaires, l'application a affiché un taux de réussite de 93 %. Cependant, le système a ses limites. Tout d'abord, l'identification ne fonctionne que si la personne que l'on veut retrouver porte les mêmes vêtements que ceux qui ont servi à créer son empreinte spatiochromatique, ce qui suppose un délai d'utilisation court. Ensuite, il peut arriver que l'application ait du mal à distinguer chaque individu dans une foule compacte. Les créateurs d'InSight reconnaissent que leur logiciel a encore besoin de progresser dans ce domaine. Le système pose également des questions en matièrematière de confidentialité, à commencer par la prise automatique des photos qui servent à créer l'empreinte.

Parmi les améliorations prévues, l'insertion d'un système de contrôle manuel afin que l'utilisateur puisse être averti et voir les clichés qui ont été pris avant d'autoriser la diffusiondiffusion des données aux smartphones voisins. L'équipe de développeurs compte également renforcer le système d'identification par les mouvements lorsque la reconnaissance par les vêtements n'est pas assez fiable. Il reste donc encore beaucoup de travail pour que l'application puisse fonctionner en conditions réelles.